Datalekken door AI: waarom de zorg extra waakzaam moet zijn

Aram Zegerius

Technisch gewetenAfgelopen weekend publiceerde het Financieele Dagblad een artikel over een trend die ons niet verbaast, maar wel zorgen baart: het aantal datalekken door AI-gebruik op de werkvloer neemt toe. De Autoriteit Persoonsgegevens ontving in 2024 en 2025 tientallen meldingen – en het aantal stijgt.

Wat ging er mis bij Eindhoven?

Het FD beschrijft een incident bij de gemeente Eindhoven. Na een steekproef van slechts 30 dagen bleek dat medewerkers cv's, jeugdzorgdocumenten en interne verslagen hadden gedeeld met gratis AI-chatbots zoals ChatGPT en Claude.

Hoe groot het lek precies is, weet de gemeente niet. De gegevens werden maar 30 dagen bewaard – daarna is de omvang niet meer vast te stellen.

Waarom dit de zorg direct raakt

Het artikel noemt expliciet jeugdzorgdocumenten. Dat zijn per definitie documenten met gevoelige patiëntinformatie, beschermd door het medisch beroepsgeheim.

Maar het probleem is breder. In de dagelijkse praktijk kopiëren en plakken zorgprofessionals tientallen keren per dag. Van EPD naar brief, van labuitslag naar overleg, van notitie naar zoekopdracht. Het is efficiënt en onvermijdelijk.

Maar in die hectiek kan het gebeuren: je stuurt per ongeluk persoonsgegevens mee in een vraag aan een AI-tool. Bij gratis tools als ChatGPT verdwijnt die informatie in een black box. Je weet niet waar het naartoe gaat, of het wordt gebruikt voor training, of het ooit terugkomt in antwoorden aan andere gebruikers.

Shadow AI: het onzichtbare risico

Het FD introduceert de term "shadow AI": medewerkers die op eigen initiatief gratis AI-tools gebruiken, buiten het zicht van de organisatie. Zelfs als een organisatie betaalde, veilige alternatieven aanbiedt, grijpen mensen vaak naar wat ze kennen.

De oplossing is niet om AI te verbieden – dat werkt niet en is ook niet wenselijk. De oplossing is om veilige alternatieven te bieden die het juiste gedrag makkelijk maken.

Hoe Ask Aletta dit anders doet

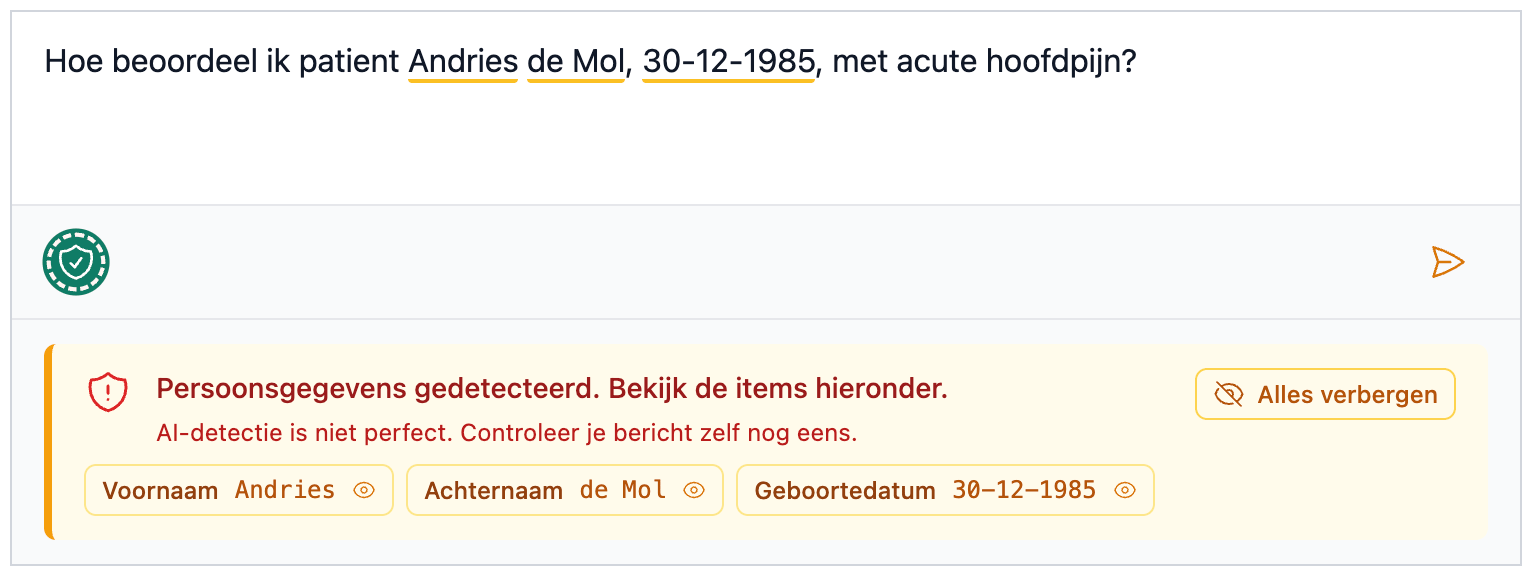

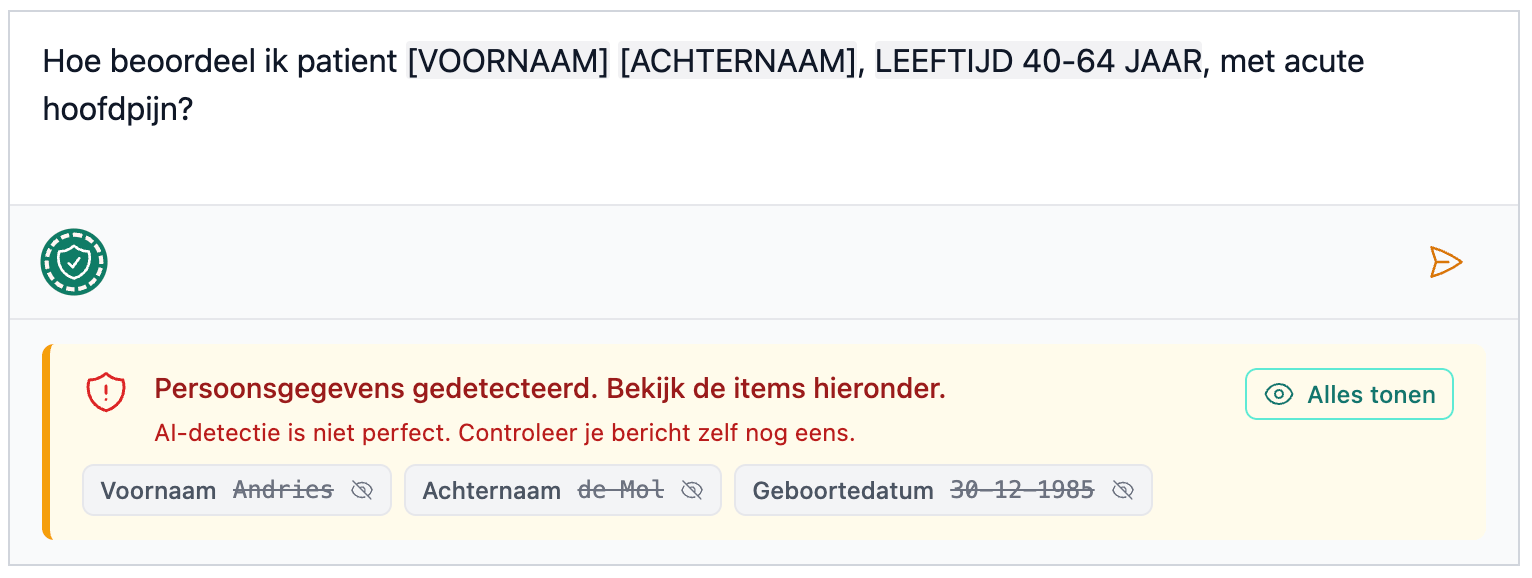

Wij hebben dit risico vanaf het begin serieus genomen. Daarom hebben we automatische PII-detectie ingebouwd in Ask Aletta.

Elke vraag wordt automatisch gecontroleerd op persoonsgegevens – vóórdat deze wordt verwerkt. Dit doen we met ons eigen detectiemodel, volledig draaiend op onze eigen infrastructuur in Nederland. Geen externe cloudproviders. Geen derde partijen.

Detecteren we iets? Dan krijg je als gebruiker direct een melding. Met één klik anonimiseer je de gevoelige data en kan je zoekopdracht alsnog veilig worden uitgevoerd.

In de hectiek van de dagelijkse praktijk is een foutje snel gemaakt. Wij helpen je die te voorkomen.